SLM(小規模言語モデル)とは

SLMとは、「Small Language Model」の略称で、「言語モデル」の一種です。日本語では「小規模言語モデル」と呼ばれます。

このSLMの解説をする前に、まず言語モデルについて解説します。

言語モデルとは、人間が日常的に使用する言語をコンピュータで処理するための仕組みのことです。

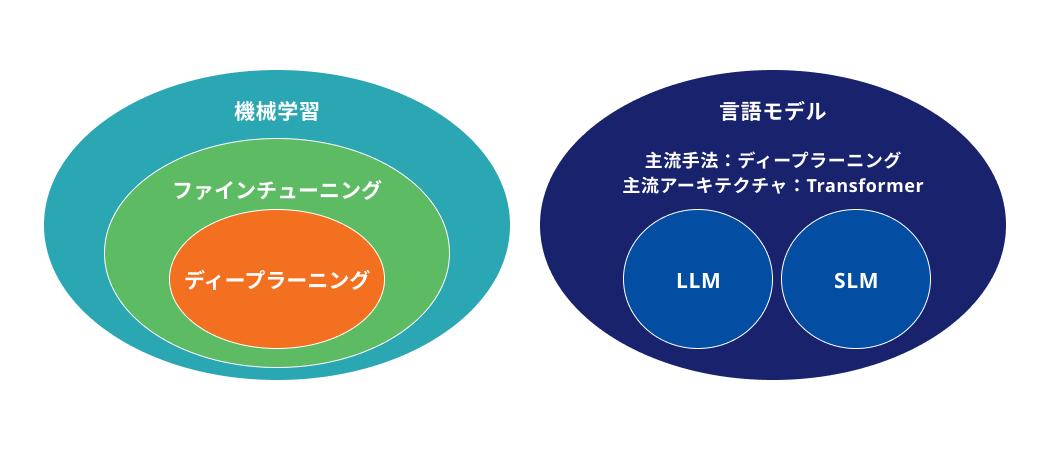

近年、言語モデルの多くは、機械学習の一種である「ディープラーニング」を用いて構築されます。ディープラーニングによって大量のデータを学習することで、文章の意味を理解したり、新しい文章を生成したりすることが可能になります。

この言語モデルを用いたアプリケーションの例としては、生成AIや検索エンジン、チャットボット、翻訳システムなどが挙げられます。一般的に、言語モデルというと生成AIのイメージが強いですが、実際には言語を扱うさまざまなアプリケーションで用いられています。

これまでは、言語モデルとして、大規模かつ汎用型のLLMが採用される傾向にありました。LLMは、「Large Language Model」の略称で、日本語では「大規模言語モデル」と呼ばれます。しかし近年では、小規模かつ特化型のSLMも注目されるようになってきています。

SLMとLLM(大規模言語モデル)の違い

SLMとLLMの主な違いは、モデルの規模や対応できる範囲にあります。

一般的に、LLMのパラメータ数は数百億から数兆規模に及びます。学習データとしては、インターネットや書籍、論文、プログラムコードなどで、非常に膨大な量のデータが用いられます。インターネット全域というケースも多いです。そのため、汎用性が高く、複雑なタスクにも対応できる傾向があります。

一方、SLMのパラメータ数は数億から数十億程度で、LLMと比べて規模が小さいのが特徴です。学習データとしても、特定の用途・分野に関するデータのみなど、限定的であることが一般的です。

なお、生成AIとして有名なOpenAIの「ChatGPT」やGoogleの「Gemini」は大規模言語モデルに分類されます。

一方、SLMを用いた生成AIとしては、Microsoftの「Phi」やGoogleの「Gemma」などが挙げられます。ChatGPTやGeminiほど一般的ではありませんが、徐々に認知を拡大しつつあります。

【関連記事】

⇒LLMとは?生成AIやChatGPTとの違い、活用事例をわかりやすく解説

SLMの仕組み

SLMとLLMは、基本的な仕組み自体に大きな違いはありません。

前述の通り、近年、言語モデルの多くは機械学習の一種であるディープラーニングによって構築されています。ディープラーニングとは、人間の脳の神経回路を模倣した手法「ニューラルネットワーク」を多層化した手法を指します。

言語モデルのアーキテクチャとしては、Googleが開発した「Transformer」と呼ばれるものが広く採用されています。Transformerの大きな特徴は、文章内の単語同士の関係を効率的に分析できる点にあります。

SLMは、LLMと同様の仕組みをベースとしつつ、パラメータ数やレイヤー数、学習データ量を抑えることで、モデルの規模を小さくしています。

SLMの3つのモデル

SLMには、「蒸留モデル」「軽量モデル」「タスク固有モデル」の3つのタイプがあり、組み合わせて使われることが多くあります。

1. 蒸留モデル

蒸留モデルとは、LLMが習得している知識を効率的に引き継ぐモデルのことです。具体的には、高性能なLLMを教師モデルとして用意し、判断基準や出力傾向などを学習します。これにより、LLMに近い性能を維持しながら、モデルの規模を小さくすることが可能になります。この蒸留モデルは、SLMにおいて一般的なアプローチの1つです。

2. 軽量モデル

軽量モデルとは、最初から小規模な構造になるように設計されるモデルのことです。具体的には、パラメータ数やレイヤー数を抑えることで計算量やメモリ消費を最小化し、低スペックの環境でも高速に動作するように設計されます。この軽量モデルは、リソースが限られているケースで利用されることが多いです。

3. タスク固有モデル

タスク固有モデルとは、例えば、文章要約、翻訳、コード生成など、特定のタスクのみを高精度で処理できるように設計されるモデルのことです。不要な機能を極力省くことで、モデルの規模を小さく保ちながらも、タスクにおける性能を最大化します。目的が明確であるほど高い性能を発揮しやすくなる一方で、目的が変わる度に再学習やモデル再構築などが必要となります。

SLMを活用するメリット

1. 開発・運用コストを抑えやすい

LLMは規模が大きいため、高性能なGPUや大規模な設備が必要となり、それだけ開発・運用コストがかさみやすい傾向があります。一方でSLMは、規模が小さいため、開発・運用コストを抑えやすい傾向があります。

2. 学習時間が短い

SLMは学習データ量が少ないため、LLMに比べて学習に要する時間が短い点が特徴です。一般的に、LLMは学習に数十日〜数ヵ月程度の時間を要するのに対して、SLMは数日程度の時間で学習が完了する場合もあります。そのため、モデルの更新や改良を短いサイクルで行いやすく、ビジネス環境の変化にも柔軟に対応できます。また、試験的な導入も行いやすいというメリットもあります。

3. 応答速度が早い

SLMは、LLMに比べてパラメータ数やレイヤー数が少ないため、応答速度が速い傾向があります。低スペックの環境でも比較的高速に動作する点も強みです。

4. 消費電力を抑えやすい

SLMは、LLMに比べて計算量が少ないため、消費電力を抑えやすいというメリットがあります。生成AIの利用が世界的に拡大し、環境負荷が課題となる中、SLMは省エネに寄与する技術として注目されています。

5. ハルシネーションのリスクが低い

LLMは膨大な量のデータを学習しているため、信頼性の低い情報が混入する可能性があります。その結果、実際には存在しない情報や誤った内容を、あたかも事実のように出力してしまうことがあります。こうした現象は「ハルシネーション」と呼ばれます。一方でSLMは、一般的に限定的なデータを用いて学習するモデルです。それだけ不要な情報やノイズを含みにくく、LLMと比べてハルシネーションのリスクが低い傾向があります。

6. ローカル環境でも利用しやすい

LLMは計算量も消費電力も大きいため、一般的には、クラウド環境を前提として利用されます。一方でSLMは、LLMと比較して計算量も消費電力も少ないため、スマートフォンやエッジデバイスなど、ローカル環境でも利用しやすいという特徴があります。

SLMをビジネスで活用する際の留意点

1. 汎用性が低い

LLMは、広範なデータを用いて学習するモデルであるため、汎用性が高く、幅広いタスクに対応できます。一方でSLMは、一般的に特定の用途・分野に特化したデータを用いて学習するモデルであるため、その用途・分野では高い性能を発揮しますが、LLMのように幅広いタスクに対応するのは得意ではありません。例えば生成AIであれば、メール作成のように一見簡単に思えるようなタスクでも、対応できない場合があります。

2. 学習データの準備に手間がかかる

LLMは通常、そのデータの準備の手間に関しては重要視されません。一方でSLMは、一般的に限定的なデータを用いて学習するモデルであるため、専門性の高い分野では、データの収集や整理に専門的な知識やスキルが必要ですし、相応の時間もかかることになります。

SLM(小規模言語モデル)の活用を含む、FPT AI Factoryの概要については、こちらの資料で紹介しています

SLMのビジネス活用事例

SLMは、実際のビジネスでもさまざまな場面で活用されています。ここでは、代表的な3つのケースを紹介します。

1. 高い精度が求められるケース

SLMは、高い精度が求められるケースで活用されています。例えば金融機関では、誤った情報が出力されれば、顧客の資産管理や投資判断などに悪影響を与える恐れがあります。また医療分野においても、誤った情報が出力されれば、患者の命に関わる深刻なトラブルにつながりかねません。特定の用途・分野で高い精度を持つSLMを活用することで、こうしたリスクを低減できます。

2. 即応性が求められるケース

SLMは応答速度が速いため、即応性が求められるケースでも活用されています。例えば、カスタマーサポートのチャットボットや、会議・講演のリアルタイム文字起こしサービスなどです。また、SLMはローカル環境でも利用しやすいため、その点からも、応答速度が求められるケースに適しています。

3. 高いセキュリティが求められるケース

SLMは、高いセキュリティが求められるケースでも活用されています。SLMは、一般的に限定されたデータを学習するため、例えば機密データなど、学習すべきでないデータを誤って学習してしまうリスクが低い傾向にあります。さらに、SLMはローカル環境でも利用しやすく、クラウドにデータを送信しない運用もできるため、情報漏洩のリスクも抑えやすくなります。

SLMの今後の展望

SLMは、開発・運用コストを抑えやすい、消費電力も少ないといったことから、導入しやすい言語モデルと言えます。これまで予算やリソースの制約により導入が難しかった企業でも、導入を検討するケースが増えていくでしょう。そのため、今後はさまざまなSLMのサービスが登場してくると期待できます。あわせて、SLMの効果的な作り方や使い方に関する情報も増えていくでしょう。

また、今後はLLMとSLMを組み合わせたハイブリッド型の活用も進むと考えられています。例えば、汎用型のタスクや複雑なタスクはクラウド上のLLMが担当し、特化型のタスクやセキュリティ性が求められるタスクはローカル上のSLMが担当する、といった形です。このようにすることで、機能面・性能面・セキュリティ面・コスト面のバランスを最適化しやすくなるでしょう。

まとめ

SLMは、LLMと同じくディープラーニングやTransformerをベースとした言語モデルですが、規模が小さい点が特徴です。パラメータ数や学習データ量を抑え、さらに特定の用途・分野に特化することで、小さなモデルを実現します。

SLMは必ずしもLLMに劣るわけではありません。LLMと比べて汎用性は低いものの、「開発・運用コストを抑えやすい」「応答速度が速い」「ハルシネーションのリスクが低い」「ローカル環境でも利用しやすい」といったメリットがあります。

今後は、LLMとSLMをタスクに応じて使い分けるハイブリッド型の活用も進んでいくでしょう。言語モデルを用いたアプリケーションがさらに使いやすくなっていくと考えられます。

AIを支える技術・関連分野についてもっと知るなら

- ファインチューニングとは?目的やRAGとの違い、やり方をわかりやすく解説

- 機械学習とは?ディープラーニングやAIとの違いを簡単に解説

- GPUとは?CPUとの違いや種類・性能、選び方までわかりやすく解説

- LLMとは?生成AIやChatGPTとの違い、活用事例をわかりやすく解説

- 人工知能(AI)とは?種類や仕組み、メリット・デメリットを解説

この記事の監修者・著者:FPTコンテンツ制作チーム

FPTコンテンツ制作チームは、ITソリューションやデジタル技術に関する情報を発信しています。業界動向や技術トピックについて、記事の制作を行っています。

監修者・著者の詳しい情報はこちら →

関連リンク

- AIサービス

- FleziPT

- FPTスマートクラウドジャパン

- FPTはServiceNowのPremierパートナーに昇格、企業のAIトランスフォーメーションを加速

- FPTと三島光産は、AIを活用した次世代製造基盤構築の協業に合意

関連ブログ:コラム

- ODC(ラボ型開発)とは?メリットやデメリット、導入手順をわかりやすく解説

- 物流DXとは何?業界の現状や課題、取り組みの具体例を徹底解説

- 地政学リスクとは?海外進出企業への影響や必要なリスクマネジメントを解説

- 2025年の崖とは何?DX化が進まない原因や課題、進める方法を解説

- リバースエンジニアリングの手法や目的、活用のメリットやリスクを徹底解説